歩容認証・サーベイランス

歩容認証(歩き方の個性による個人認証)は,対象人物から遠く離れた場所でも利用できる唯一の生体情報(バイオメトリクス)として注目を集めています.6万人規模の世界最大の歩行映像データベースを活用して,深層学習に基づく認証手法を開発すると共に,その実利用として,捜査員向けの歩容鑑定システムも開発しています.また,より一般的なサーベイランス技術として,人物検出・追跡・領域抽出・移動軌跡解析などの要素技術の開発にも取り組んでいます.

歩容鑑定システム

八木研究室の歩容認証技術は,2009年に日本で初めて防犯カメラ映像からの歩容鑑定に用いられました.2013年には,世界初の捜査員向けの歩容鑑定システムを構築し,警察庁科学警察研究所にて試験運用を開始し,2016年には,本システムを用いた歩容鑑定結果が,日本で初めて裁判所での証拠として認められました.

文献:

H. Iwama, D. Muramatsu, Y. Makihara, Y. Yagi, ``Gait Verification System for Criminal Investigation,'' IPSJ Trans. on Computer Vision and Applications, Vol. 5, pp. 163-175, Oct. 2013.

H. Iwama, D. Muramatsu, Y. Makihara, Y. Yagi, ``Gait-based Person-Verification System for Forensics,'' In Proc. IEEE 5th Int. Conf. on Biometrics: Theory, Applications and Systems, Washington D.C., No. Paper ID: 49, pp. 1-8, Sep. 2012.

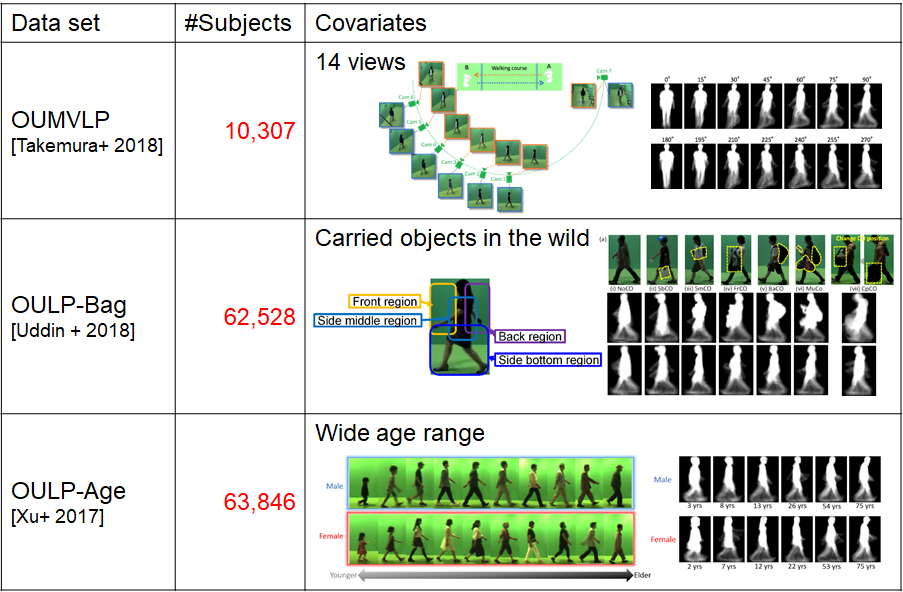

世界最大の歩行映像データベース

八木研究室では,日本科学未来館での体験型の歩行映像解析デモ展示「アルクダケ」と並行してデータ収集を実施し,60,000人以上の被験者を含む世界最大の歩行映像データベースを所有しています.本データベースは,14方向からの多視点映像,自然な荷物所持状況,幅広い性別・年代層を含んでおり,大量の学習データを必要とする深層学習ベースの歩容認証には必要不可欠なデータセットであるため,世界中で幅広く用いられています.

文献:

N. Takemura, Y. Makihara, D. Muramatsu, T. Echigo, Y. Yagi, ``Multi-view Large Population Gait Dataset and Its Performance Evaluation for Cross-view Gait Recognition,'' IPSJ Transactions on Computer Vision and Applications, Vol. 10, No. 4, pp. 1-14, Feb. 2018.

M.Z. Uddin, T.T. Ngo, Y. Makihara, N. Takemura, X. Li, D. Muramatsu, Y. Yagi, ``The OU-ISIR Large Population Gait Database with Real-Life Carried Object and its performance evaluation,'' IPSJ Transactions on Computer Vision and Applications, Vol. 10, No. 5, pp. 1-11, May 2018.

C. Xu, Y. Makihara. G. Ogi, X. Li, Y. Yagi, J. Lu, ``The OU-ISIR Gait Database Comprising the Large Population Dataset with Age and Performance Evaluation of Age Estimation,'' IPSJ Trans. on Computer Vision and Applications, Vol. 9, No. 24, pp. 1-14, Dec. 2017.

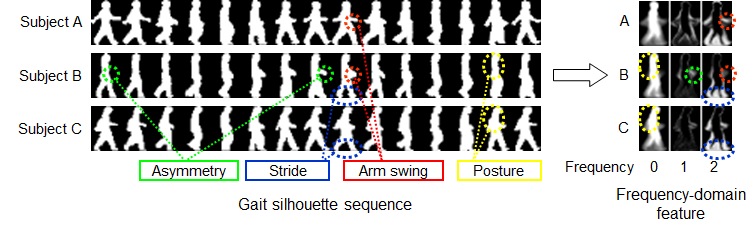

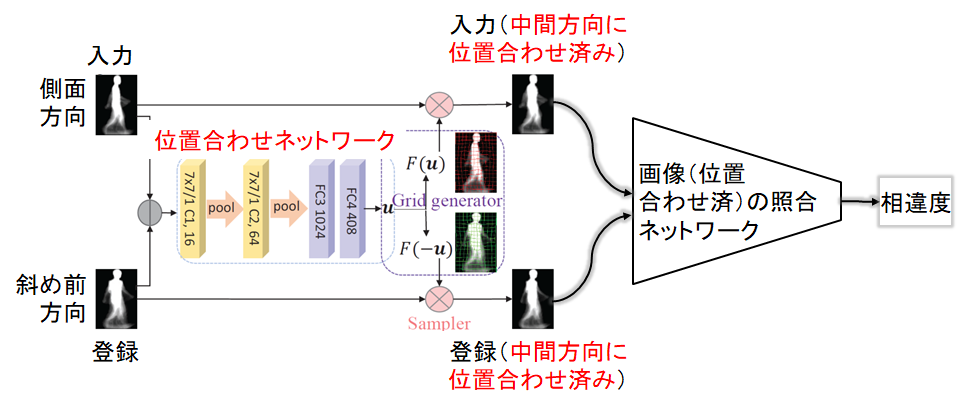

深層学習による条件変化に頑健な歩容認証

上記の世界最大の歩行映像データベースを活用して,深層学習による歩容認証技術を開発しています.特に,本人認証と個人識別の問題設定を考慮した入出力構造や,観測方向変化に頑健な変形ネットワークの利用,荷物所持要素と個人要素への分解ネットワークなど,歩容認証の特性を考慮したネットワーク設計を行っています.

文献:

Chi Xu, Yasushi Makihara, Xiang Li, Yasushi Yagi and Jianfeng Lu, ``Cross-View Gait Recognition using Pairwise Spatial Transformer Networks,'' IEEE Transactions on Circuits and Systems for Video Technology, 2020. (Accepted)

Xiang Li, Yasushi Makihara, Chi Xu, Yasushi Yagi, Mingwu Ren, ``Gait recognition invariant to carried objects using alpha blending generative adversarial networks,'' Pattern Recognition. 2020. (Accepted)

Xiang Li, Yasushi Makihara, Chi Xu, Yasushi Yagi, Mingwu Ren, ``Gait Recognition via Semi-supervised Disentangled Representation Learning to Identity and Covariate Features,'' Proc. the 33rd IEEE Conf. on Computer Vision and Pattern Recognition (CVPR 2020), Seattle, WA, USA, pp. 1-11, Jun. 2020.

N. Takemura, Y. Makihara, D. Muramatsu, T. Echigo, Y. Yagi, ``On Input/Output Architectures for Convolutional Neural Network-Based Cross-View Gait Recognition,'' IEEE Transactions on Circuits and Systems for Video Technology, Vol. 29, No. 9, pp. 2708-2719, Sep. 2019.

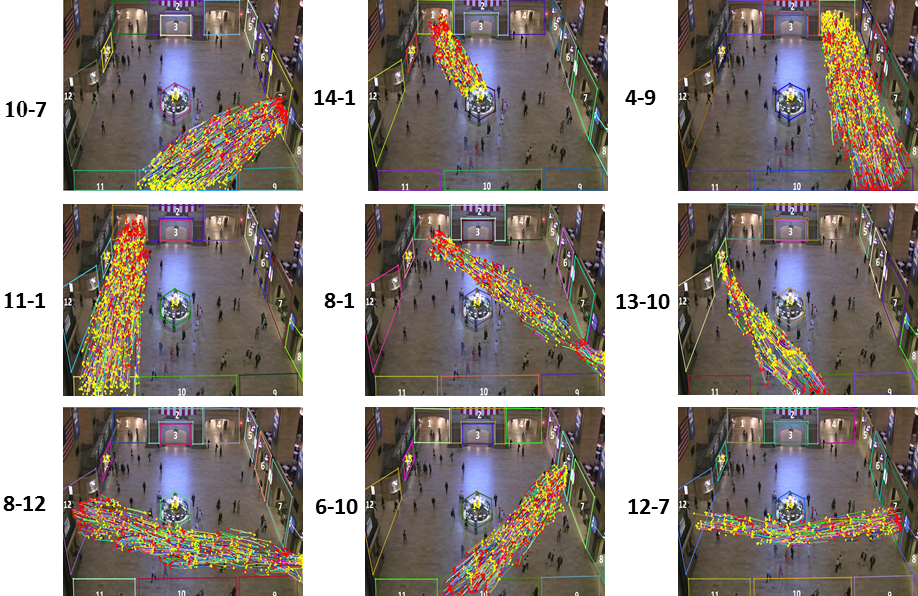

人物検出・追跡・領域抽出・移動軌跡解析

上記の歩容認証やサーベイランス技術の実現に向けて,その前段処理である人物検出・追跡・領域抽出・移動軌跡解析といった要素技術の開発にも取り組んでいます.例えば,時空間的な局所特徴量である Spatio-temporal Histogram of Oriented Gradient (STHOG) を用いた歩行者検出,色と形状情報の適応的選択による人物追跡,混雑環境下での人物軌跡クラスタリング等に取り組んでいます.

文献:

A.S. Hassanein, M.E. Hussein, W. Gomaa, Y. Makihara, Y. Yagi, ``Identifying motion pathways in highly crowded scenes: a non-parametric tracklet clustering approach,'' Computer Vision and Image Understanding, Vol. 191, No. 102710, pp. 1-18, Feb. 2020.